Stable Diffusion web UI : Pythonコマンドのみでインストール

はじめに

『Stable Diffusion web UI』をWindows11での実装方法でふ、

よく、BATファイルを用いた方法が述べられておりまふが、

おいらはパイソニストとして、Pythonのみで実装しておりまふ(-。-)y-゜゜゜

また、あまり興味ある人は少ないと思いまふが、

『Stable Diffusion』の仕組みについておまけに書いておきまふた(‘◇’)

実装

環境

Windows11 pro (Windows Insier Program)

マウスコンピューター製G-Tune E5-144

CPU:インテル(R) Core(TM) i7-10875H プロセッサー

メモリ:32GB メモリ

SSD (M.2):512GB NVMe SSD

グラフィックス:NVIDIA GeForce RTX2060 / 6GB

Python : 3.10 (pyenvを使用)

CUDA : 1.17

方法

Git Clone

|

1 |

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git |

カレントディレクトリの移動

|

1 |

cd stable-diffusion-webui |

仮想環境構築と起動

|

1 2 3 |

pyenv local 3.10.5 python -m venv venv venv/scripts/activate |

初期設定コマンド(起動コマンド)

|

1 |

python launch.py |

このコマンドで、必要ライブラリをインストールしてくれます、なんと便利!!

学習済みモデルを配置していないので、エラーがでます。

学習済みモデルを配置後、同じコマンドを行います。

学習済みモデルを配置

『stable-diffusion-webui\models\Stable-diffusion』のフォルダのなかに『***.safetensors』の様な学習済みモデルを保存します。

『Hugging Face』や『Civitai』からダウンロードできます。

起動

|

1 |

python launch.py |

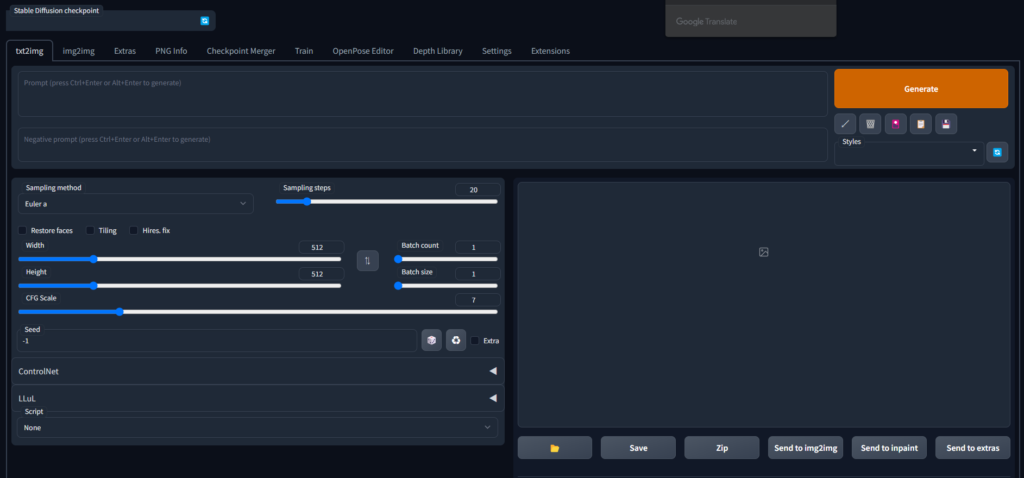

http://127.0.0.1:7860へアクセス

さぷりぺんたんをつくってみた

まだまだ、プロンプトを精査せねば(@_@)

おわりに

説明にはビデオメモリが8GB必要と書いてありまふがた、

6GBの環境でも普通に動きまふ(‘ω’)ノ

詳しい使い方は、また次回。(‘◇’)ゞ

おまけ

Stable Diffusion について。

Stable Diffusion web UI」は、WebベースのUIで、ブラウザウィンドウからStable Diffusionを簡単に操作できるようになっています1。このプロジェクトには、Gradio、または、FastAPI2つのWeb UIが選択できます1。また、画像の拡大や強化には、GFPGAN や realESRGAN などの画像アップスケーラーが組み込まれています。

Stable Diffusion は、大きく三つの工程(モジュール)で生成しまふ。

1.テキストから情報を抽出:CLIPエンコーダ

2.抽出された情報から圧縮画像を生成:拡散モデル

3.生成した圧縮画像から画像に変換:VAEデコーダ

で構成されておりまふ。

Stable Diffusion web UI でどれが担っているのかは、また今後説明(‘◇’)

関連ページ